RAG 신뢰성 위기와 LLMOps의 필연성

RAG(Retrieval-Augmented Generation)는 기업용 AI 시스템에서 사실상 표준 구조로 자리 잡은 듯 보입니다. 외부 지식을 활용해 최신 정보를 반영할 수 있다는 점은 분명한 강점입니다. 그러나 동시에 새로운 과제도 함께 드러나고 있습니다. 검색 시스템의 불완전성과 LLM의 확률적 생성 방식이 결합되면서 결과의 품질을 일관되게 통제하기가 쉽지 않을 수 있기 때문입니다. 특히 금융이나 의료처럼 신뢰성이 중요한 영역에서는 단 한 번의 할루시네이션도 심각한 비즈니스 리스크로 이어질 수 있습니다.

기존의 소프트웨어 테스트와 달리, LLM의 출력은 정답이 명확하지 않은 경우가 많습니다. 사람이 일일이 검수하는 방식은 초기에는 유효할지 몰라도 트래픽이 증가하면 확장성 측면에서 한계에 부딪힐 가능성이 큽니다.

이러한 배경에서 등장한 개념이 LLMOps입니다. 핵심은 모델을 블랙박스로 두지 않고 데이터 기반으로 품질을 지속적으로 측정하고 관리하려는 시도입니다. 즉, AI 시스템을 단순한 개발 대상이 아니라 운영 대상으로 바라보는 관점의 전환이라고 볼 수 있습니다.

RAGAS 프레임워크와 RAG Triad 지표

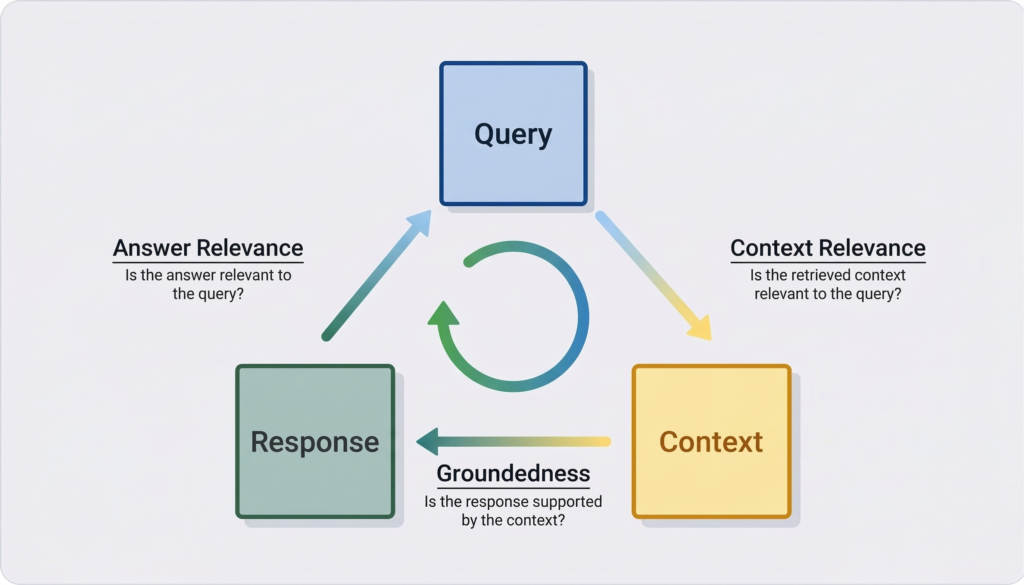

이처럼 데이터 기반으로 품질을 측정하고 관리하는 LLMOps 운영 체계의 중심에는 RAGAS(RAG Assessment)라는 평가 프레임워크가 있습니다. RAGAS는 RAG 시스템을 ‘RAG Triad‘라 불리는 세 가지 축으로 나누어 분석합니다.

- Context Precision

검색된 문서가 실제로 답변에 필요한 정보를 얼마나 정확하게 포함하고 있는지를 측정합니다. 단순히 관련 문서의 존재 여부를 넘어서, 중요한 정보가 검색 결과 상단에 얼마나 잘 노출되는지를 평가하는 것이 핵심입니다. - Faithfulness

생성된 답변이 제공된 문맥에 근거하고 있는지를 검증합니다. 모델이 외부 지식을 임의로 추가하지 않고, 주어진 Context에 기반해 답변했는지를 평가하는 지표로, 할루시네이션을 직접적으로 통제합니다. - Answer Relevance

생성된 답변이 사용자의 질문 의도와 의미적으로 얼마나 일치하는지를 평가합니다. 질문의 핵심을 정확히 반영하고 있는지를 기준으로 판단합니다.

이해를 돕기 위해 일상적인 예시를 하나 가정해 보겠습니다.

질문: “카페인이 적은 커피는 뭐가 있나요?”

검색된 문서:

- 문서 A: “디카페인 커피는 일반 커피 대비 카페인 함량이 매우 낮습니다.”

- 문서 B: “아메리카노는 물을 섞은 커피입니다.”

- 문서 C: “커피 원두는 로스팅 정도에 따라 맛이 달라집니다.”

모델 답변: “카페인이 적은 커피로는 디카페인 커피가 있습니다.”

이 상황을 기준으로 각 지표를 해석하면 다음과 같습니다.

- Context Precision

실제 답변에 기여한 문서는 [문서 A]뿐이며, 나머지 문서들은 질문과 직접적인 관련이 없습니다.

따라서 불필요한 문서가 함께 검색되었다면 Context Precision은 낮아지게 됩니다.

핵심은 “관련 문서가 포함되었는가”가 아니라, “필요한 문서가 얼마나 정확하게 상위에 노출되었는가”입니다. - Faithfulness

모델의 답변은 [문서 A]의 내용을 기반으로 생성되었습니다.

추가적인 추측이나 외부 지식 없이 제공된 문맥에 충실하게 답변했기 때문에 Faithfulness는 높게 평가됩니다.

반대로 “라떼는 카페인이 적습니다”처럼 문맥에 없는 내용을 생성했다면 이는 할루시네이션으로 간주됩니다. - Answer Relevance

답변은 질문의 핵심인 “카페인이 적은 커피”에 정확히 대응하고 있습니다.

불필요한 설명 없이 질문 의도에 맞게 응답했기 때문에 관련성 역시 높게 평가됩니다.

만약 “커피는 다양한 종류가 있습니다”처럼 질문의 핵심을 벗어난 답변이라면 관련성 점수는 낮아지게 됩니다.

이 세 가지 지표는 서로 보완적으로 작동하며, 단순히 “답변이 맞다/틀리다”를 넘어서 문제가 발생한 지점을 단계별로 구분할 수 있게 해줍니다.

예를 들어 Context Precision이 낮다면 검색 단계의 문제로, Faithfulness가 낮다면 생성 단계의 문제로, Answer Relevance가 낮다면 사용자 의도 해석 또는 프롬프트 설계의 문제로 진단할 수 있습니다.

LLM-as-a-Judge: 평가 자동화

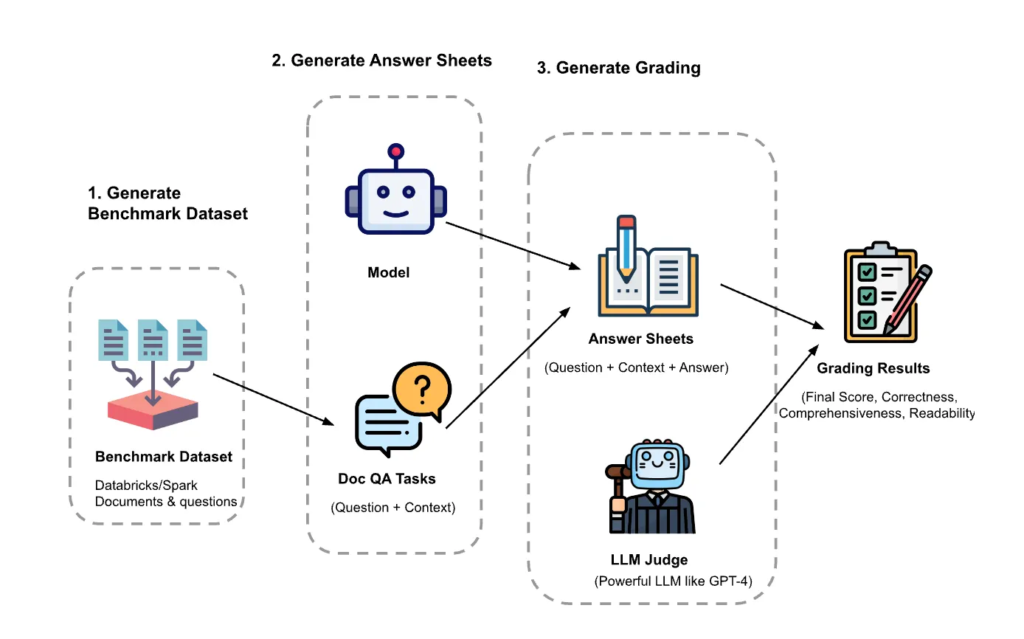

이러한 정량 지표를 실제 서비스 환경에서 적용하려면 대량의 응답을 자동으로 평가할 수 있는 메커니즘이 필요합니다. 이를 위해 활용되는 방식이 LLM-as-a-Judge입니다.

LLM-as-a-Judge는 상위 모델이 다른 모델의 응답을 평가하고 점수를 부여하는 구조로 문맥 적합성과 논리적 일관성을 기준으로 결과를 정량화할 수 있도록 합니다. 이를 통해 수만 건 이상의 서비스 로그를 사람의 개입 없이도 효율적으로 분석할 수 있습니다.

다만 이 방식에도 한계는 존재합니다. 동일 계열 모델에 더 높은 점수를 주는 self-preference bias나, 답변이 길수록 더 우수하다고 판단하는 verbosity bias가 대표적입니다. 따라서 평가 자동화는 어디까지나 보조 수단으로 활용되어야 하며, 주기적인 인간 검수를 통해 AI 평가 결과를 교정하는 과정이 병행되어야 합니다.

이러한 평가 체계를 실제 시스템에 적용하기 위해서는, 파이프라인 전반을 구성하는 적절한 기술 스택이 필요합니다.

LLMOps 실무 구현을 위한 핵심 솔루션 스택 (Solution Stack)

AGAS와 LLM-as-a-Judge 기반 평가 체계를 실제 서비스에 적용하기 위해서는 데이터 흐름(Pipeline) 단계별로 적절한 도구를 선택하는 것이 중요합니다.

1. 데이터 인덱싱 및 오케스트레이션 (Orchestration)

LLM과 외부 데이터 소스를 연결하고 전체 워크플로우를 구성하는 핵심 역할을 합니다.

- LangChain: RAG 파이프라인 구축의 사실상 표준으로, 다양한 LLM 및 DB와의 연동을 지원하며 복잡한 체인 구조를 설계하는 데 적합합니다.

- LlamaIndex: 데이터 인덱싱과 쿼리에 특화된 프레임워크로, PDF나 Notion과 같은 비정형 문서를 구조적으로 파싱하여 검색 품질을 높이는 데 강점을 가집니다.

2. 고성능 검색 및 시맨틱 캐싱 (Vector DB)

비정형 데이터를 벡터화하여 저장하고 유사도 기반의 고속 검색을 수행하는 저장소입니다.

- Pinecone / Milvus: 대규모 데이터셋에서도 빠른 검색 성능을 제공하는 벡터 데이터베이스로, 확장성이 요구되는 환경에서 널리 사용됩니다.

- Redis Stack: 캐싱과 벡터 검색을 결합한 구조로, 시맨틱 캐싱 구현에 효과적으로 활용됩니다.

3. 정량적 평가 및 프롬프트 관리 (Evaluation & Monitoring)

앞서 언급한 RAGAS 지표를 자동 산출하고 모델의 성능 변화를 모델 성능 변화를 추적합니다.

- Ragas / Arize Phoenix: RAG Triad 지표를 계산하고 평가 리포트를 생성합니다. 특히 Arize Phoenix는 검색 문서와 답변 간 관계를 시각화하여 품질 저하 지점을 추적하는 데 유용합니다.

- Weights & Biases (W&B) / MLflow: 프롬프트 변경에 따른 결과 변화를 기록하여, 모델 성능을 데이터 기반으로 비교·분석할 수 있도록 지원합니다.

4. 보안 가드레일 및 추론 최적화 (Security & Serving)

안전한 답변 생성과 효율적인 추론 환경을 구성하기 위한 핵심 구성 요소입니다.

- NVIDIA NeMo Guardrails: 입력과 출력을 제어하여 정책 위반 및 위험한 응답을 차단합니다.

- vLLM: 메모리 효율을 개선하여 동일 GPU 자원으로 더 많은 요청을 처리할 수 있도록 하는 고성능 추론 엔진입니다.

운영 효율화 아키텍처: 시맨틱 캐싱과 보안

앞서 살펴본 솔루션들은 단순히 개별 도구로 존재하는 것이 아니라 실제 운영 환경에서는 하나의 아키텍처로 결합되어 작동합니다. 이 과정에서 비용과 성능을 동시에 최적화하기 위한 핵심 기법이 시맨틱 캐싱입니다.

자연어 질문은 표현이 조금만 달라져도 문자열 기준으로는 완전히 다른 요청처럼 보일 수 있지만 임베딩 공간에서는 매우 유사한 위치에 존재할 수 있습니다. 이 특성을 활용해 유사도가 일정 임계치(ex 0.95 이상)를 넘는 경우 기존 답변을 재사용하면 모델 호출 횟수를 줄여 비용을 절감하고 응답 속도를 효과적으로 개선할 수 있습니다.

보안 측면에서도 단순 필터링을 넘어서는 접근을 할 필요가 있습니다. Semantic Guardrails는 입력 단계에서 Prompt Injection을 방어하고, 출력 단계에서는 개인정보 유출이나 정책 위반 여부를 실시간으로 감지합니다. 이러한 구조는 서빙 엔진의 최적화와 결합될 때, 안전성과 성능을 동시에 확보하는 기반이 될 수 있습니다.

한계점 및 향후 발전 방향

물론 현재 구조에도 한계는 존재할 수 있습니다. 평가를 위해 별도의 LLM 호출이 필요하다는 점은 비용과 지연 시간 측면에서 부담으로 작용하며, 모든 응답을 실시간으로 평가하는 것은 계산량 측면에서도 비효율적입니다.

이러한 문제를 해결하기 위해 최근에는 경량화된 평가 전용 모델인 sLLM을 내부에 배치하는 방식이 주목받고 있습니다. 또한 사용자 피드백을 직접 학습에 반영하는 DPO(Direct Preference Optimization) 방식이 등장하면서, 평가와 개선이 하나의 루프로 통합되는 방향으로 발전하고 있습니다.

데이터 기반 AI 운영의 중요성

결국 AI 시스템의 신뢰성은 선언이 아니라 측정의 문제입니다. “우리 AI는 똑똑하다”는 표현보다 “현재 시스템의 Faithfulness는 92% 수준을 유지하고 있다”는 식의 객관적인 지표가 실제 운영에서는 훨씬 중요한 의미를 가집니다. RAGAS가 여전히 유효한 이유도 여기에 있습니다. 빠르게 변화하는 기술 환경 속에서도 시스템의 품질을 일관되게 측정할 수 있는 기준을 제공하기 때문입니다.

지속 가능한 AI 서비스는 모델이 아니라 시스템에서 만들어집니다. 그리고 그 시스템의 품질은 얼마나 정교하게 측정하고 운영하느냐에 따라 결정됩니다. RAGAS와 같은 평가 체계, LLM-as-a-Judge 기반 자동화 그리고 이를 뒷받침하는 LLMOps 아키텍처는 이제 선택이 아닌 필수 요소입니다.

앞으로의 경쟁력은 더 좋은 모델이 아니라, 더 잘 운영되는 시스템에서 결정됩니다.